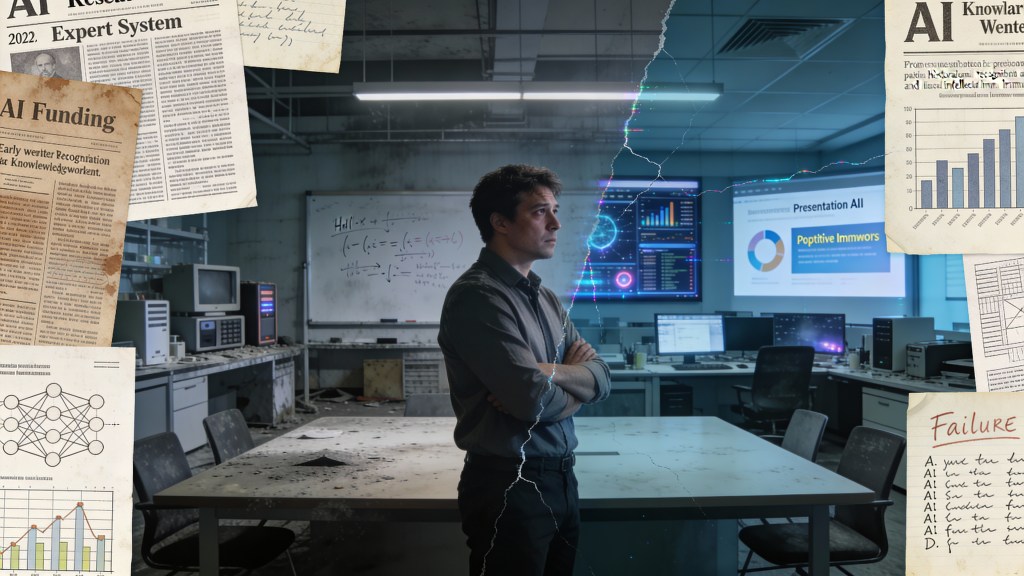

เมื่อเราพูดคำว่า “เรียนรู้ AI”

คนส่วนใหญ่มักนึกถึงสิ่งเหล่านี้ทันที

- การเขียน prompt ให้เก่ง

- การใช้ ChatGPT ให้เร็ว

- การเรียกใช้ OpenAI API

- การ fine-tune โมเดล

ทั้งหมดนี้ ไม่ผิด

แต่เป็นเพียง “ผิวหน้า” ของภูเขาน้ำแข็ง

” ด้านนอกของภูเขาน้ำแข็ง ”

เมื่อเราพูดคำว่า “เรียนรู้ AI”

ปัญหาของการเรียนรู้ AI แค่ในระดับ “เครื่องมือ” คือ

เราจะไม่เข้าใจคำถามที่สำคัญกว่านั้น เช่น

- ทำไม AI ถึงผิดพลาดในรูปแบบเดิมซ้ำ ๆ

- ทำไมระบบที่เดโมดูฉลาดมาก ถึงพังเมื่อใช้งานจริง

- ทำไมคำสัญญาของ vendor ถึงไม่ตรงกับผลลัพธ์ที่เกิดขึ้น

และที่สำคัญที่สุดคือ

สิ่งเหล่านี้ ไม่ใช่ความซวยของโปรเจกต์นี้

ไม่ใช่เพราะทีมนี้ไม่เก่ง

และไม่ใช่เพราะคุณเขียน prompt ไม่ดีพอ

มันคือ pattern

pattern ที่เกิดซ้ำมาแล้วกว่า 50 ปี

AI ปัจจุบันคือผลลัพธ์ของความล้มเหลวในอดีต

ถ้าเราย้อนเวลากลับไปประมาณ 70 ปี

เราจะพบจุดเริ่มต้นของคำถามที่ยังไม่เคยถูกแก้จริง

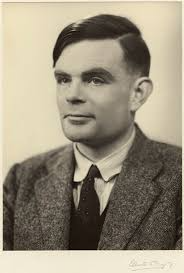

ในปี 1950

Alan Turing

ตีพิมพ์บทความ “Computing Machinery and Intelligence”

และเสนอคำถามเรียบง่ายแต่รุนแรงว่า

“เครื่องจักรสามารถคิดได้หรือไม่?”

Turing ไม่ได้ปล่อยให้คำถามนี้เป็นปรัชญา — เขาขอบเหล่านี้ให้มีคำตอบได้ เขาเสนออะไรที่เรียกว่า “Turing Test” หรือ “Imitation Game” ซึ่งเป็นการทดสอบเรียบง่าย: ถ้าเครื่องจักรสามารถคุยกับมนุษย์ในลักษณะที่ผู้สอบสวนคิดว่าเป็นมนุษย์ แล้ว นั้นก็หมายความว่าเครื่องสามารถ “คิด” ได้

The Imitation Game: เกมสังคมแบบวิคตอเรีย

เพื่ออธิบายแนวคิดนี้

Turing อ้างถึงเกมในยุควิคตอเรีย

ซึ่งเป็นเกมปาร์ตี้ที่เล่นกันจริง

เกมต้นฉบับ (Victorian Parlor Game)

ผู้เล่นมี 3 คน:

- Player A: ชาย

- Player B: หญิง

- Player C: ผู้สอบถาม (ไม่รู้ว่าใครเป็นใคร)

กติกา:

- Player C อยู่ในห้องแยก

- สื่อสารกับ A และ B ผ่านตัวอักษรเท่านั้น

- Player A พยายาม “หลอก” ให้คิดว่าตนเป็นหญิง

- Player B พยายามช่วยให้ผู้สอบถามตอบถูก

- Player C ต้องตัดสินว่า ใครคือชาย ใครคือหญิง

คำถามอาจเป็นเช่น

“ช่วยเขียนบทกวีให้หน่อย”

หรือ

“เล่าเรื่องตัวเองสักหน่อย”

แล้วให้ผู้ฟังฟังคำตอบและตอบคำถามว่า คำถามนั้นมาจาก ชายหรือหญิง…

Turing’s Twist: จากคน → เครื่องจักร

Turing ปรับเกมนี้เพียงเล็กน้อย

แต่ผลลัพธ์ทางความคิดเปลี่ยนไปอย่างสิ้นเชิง

แทนที่จะเป็น

- Player A = ชาย

- Player B = หญิง

เขาเสนอว่าให้เป็น

- Player A = เครื่องจักร (คอมพิวเตอร์)

- Player B = มนุษย์

- Player C = ผู้สอบถาม (ไม่รู้ว่าใครเป็นใคร)

คำถามของ Turing คือ:

ถ้าเครื่องจักรสามารถทำให้ผู้สอบถาม

แยกไม่ออกว่าอีกฝั่งเป็นมนุษย์หรือไม่

เราควรปฏิเสธความฉลาดของมันจริงหรือ?

ถ้าเครื่องจักร

“หลอกได้พอ ๆ กับมนุษย์จริง”

ในการสนทนาผ่านภาษา

Turing เสนอว่า

เราควรยอมรับว่า

มัน ( คอมพิวเตอร์ ) มีความฉลาดในความหมายเชิงปฏิบัติ

คำทำนายของ Turing: ผิด…หรือแม่นกว่าที่คิด?

นี่คือส่วนที่สำคัญมากในประวัติศาสตร์ AI

Turing ไม่ได้หยุดแค่การตั้งกรอบทดสอบ

เขา ทำนายเวลา

เขาเขียนไว้ว่า:

“I believe that in about fifty years’ time

it will be possible to programme computers…

so well that an average interrogator

will not have more than 70 percent chance

of making the right identification

after five minutes of questioning.”

แปลความหมายคือ:

- ประมาณ 50 ปี (ราวปี 2000)

- จะมีเครื่องจักรที่ทำให้ผู้สอบถามแยกผิดถูกเกิน 30%ภายในเวลา 5 นาที

ถ้ามองในเชิงเทคโนโลยี

คำทำนายนี้ ไม่เกิดขึ้นในปี 2000

แต่ Turing ยังทำนายอีกสิ่งหนึ่ง

ที่สำคัญไม่แพ้กัน

“At the end of the century…

one will be able to speak of machines thinking

without expecting to be contradicted.”

แปลว่า:

ในช่วงปลายศตวรรษ

สังคมจะเปลี่ยนไปจน

การพูดว่า “เครื่องจักรคิดได้”

จะไม่ถูกโต้แย้งอย่างรุนแรงอีกต่อไป

และในจุดนี้

Turing แม่นอย่างน่าขนลุก

ในปี 2022–2025

ผู้คนทั่วโลกพูดว่า

“AI คิดได้”

“AI เข้าใจ”

“AI ฉลาด”

โดยแทบไม่รู้สึกว่ามันเป็นคำพูดแปลกอีกต่อไป

ไม่กี่ปีต่อมา ในปี 1956

การประชุมเล็ก ๆ ชื่อว่า

Dartmouth Summer Research Project on Artificial Intelligence

ได้ให้กำเนิดศาสตร์ที่เรียกว่า Artificial Intelligence อย่างเป็นทางการ

ผู้เข้าร่วมประชุมประกอบด้วยบุคคลสำคัญของวงการ เช่น

- John McCarthy

- Marvin Minsky

- Claude Shannon

- Allen Newell

- Herbert Simon

ในข้อเสนอที่ส่งไปยัง Rockefeller Foundation

พวกเขาเขียนประโยคที่กลายเป็นสัญลักษณ์ของยุคนั้นว่า

“Every aspect of learning or any other feature of intelligence

can in principle be so precisely described

that a machine can be made to simulate it.”

ถ้าแปลความเชื่อนี้เป็นภาษาง่าย ๆ

มันหมายถึงประมาณนี้:

- ถ้าเรา อธิบายเหตุผลของมนุษย์ได้แม่นพอ

- ถ้าเรา เขียนมันออกมาเป็นกฎ

- ถ้า A เป็นจริง และ B เป็นจริง ให้ทำ C

เครื่องจักรก็จะฉลาดเหมือนมนุษย์ได้

ในยุคนั้น

“ความรู้” ถูกมองว่าเท่ากับ “การแทนค่า” (representation)

ถ้าเราเข้ารหัสความรู้ลงไปได้ครบ

เครื่องจักรก็จะ “รู้”

และที่สำคัญที่สุดคือ

พวกเขาเชื่อว่า

“In a couple of summers, we’ll solve AI.”

นี่คือจุดเริ่มต้นของ

Symbolic AI

และในขณะเดียวกัน

ก็คือจุดเริ่มต้นของความล้มเหลวครั้งใหญ่ครั้งแรกของ AI

อ่านต่อบทที่ 2 ความล้มเหลวครั้งแรก: Symbolic AI และความเข้าใจผิดพื้นฐาน